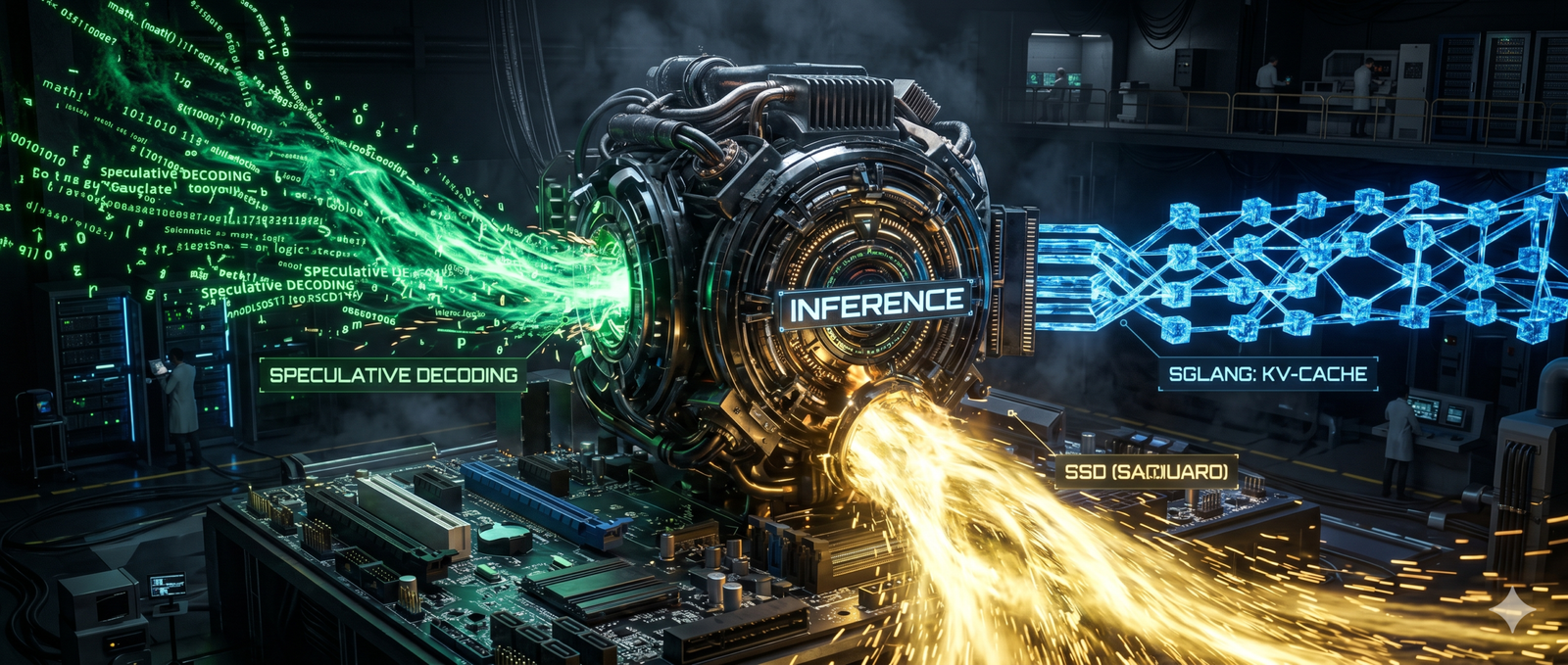

Cómo Acelerar la Inferencia: Speculative Decoding, SGLang y SSD

Optimizando la latencia y el rendimiento de LLMs en entornos de producción

En la era moderna de la Inteligencia Artificial, la velocidad no es solo un lujo, es una métrica de viabilidad comercial. El gran desafío de los Grandes Modelos de Lenguaje (LLM) es su naturaleza secuencial: la decodificación autorregresiva. Este proceso obliga a las GPUs a cargar miles de millones de parámetros repetidamente solo para generar un token adicional.

1. Speculative Decoding: El Pasante y el Editor

El concepto de Speculative Decoding aborda el problema dividiendo el trabajo entre dos IAs. Un modelo borrador (Draft Model) rápido genera tokens probables que el modelo objetivo (Target Model) verifica en paralelo. Esta técnica es fundamentalmente lossless, garantizando que el resultado final sea estadísticamente idéntico al modelo más potente.

Para profundizar en cómo estas arquitecturas de seguridad impactan el ecosistema, revisa nuestro análisis sobre Claude Mythos e Inteligencia Artificial.

2. SGLang y la Magia de RadixAttention

Ejecutar programas de lenguaje estructurado presenta ineficiencias críticas de memoria. SGLang soluciona esto mediante RadixAttention, una innovación que guarda el historial de la caché KV en una estructura de árbol radix, permitiendo que los prompts compartidos ahorren ingentes cantidades de poder de cómputo.

3. Speculative Speculative Decoding (SSD)

La técnica SSD lleva la paralelización al límite eliminando el tiempo de inactividad del modelo borrador. Mediante el Algoritmo Saguaro, el modelo pequeño pre-especula simultáneamente múltiples ramificaciones basadas en los posibles rechazos del verificador.

Conclusión: El Futuro Acelerado

La integración de Speculative Decoding, SGLang y SSD está democratizando las interacciones instantáneas con los modelos más potentes del planeta. En ConfiguroWeb, implementamos estas arquitecturas para garantizar escalabilidad y eficiencia en cada línea de código.

¿Necesitas Optimizar tu Inferencia?

Ayudo a empresas a implementar estas arquitecturas de vanguardia para reducir latencia y costos de GPU.

💬 Consultoría por WhatsApp• ArXiv 2211.17192 (Speculative Decoding)

• ArXiv 2312.07104 (SGLang)

• Algoritmo Saguaro (SSD Implementation)